|

|

专注AIGC领域的专业社区,关注微软&OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!$ J, B/ F4 G1 J/ x( m, f, e

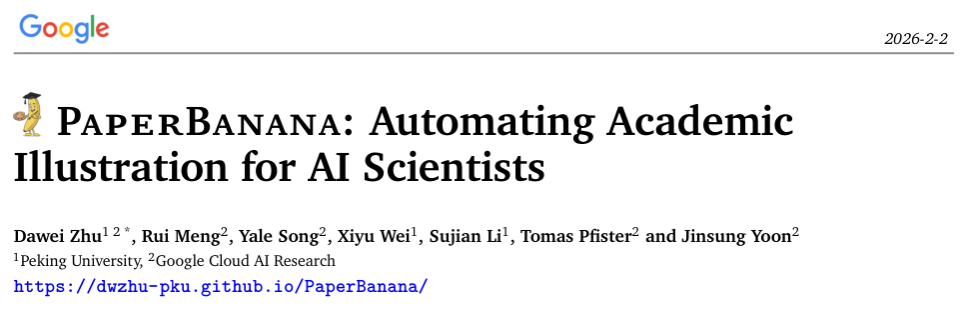

北京大学与谷歌云AI研究团队联合推出了PaperBanana。

9 y/ F8 ], G. t: g

五大智能体联手,让AI画出NeurIPS级别的图表。

五大智能体联手,让AI画出NeurIPS级别的图表。

2 a E4 f3 Y) @/ T- i1 pPaperBanana给每位AI科学家配备了一个专属的设计团队,学术插图将不再依赖人工手绘。

4 |: {9 m2 ?& r2 _" e! X y

它通过检索、规划、风格设计、绘图和自我修正五个步骤,能够将枯燥的论文方法描述和标题转化为达到出版标准的精美图表。7 V6 g5 {; A8 Z8 D0 `8 v, h' z- y3 r# |

它通过检索、规划、风格设计、绘图和自我修正五个步骤,能够将枯燥的论文方法描述和标题转化为达到出版标准的精美图表。7 V6 g5 {; A8 Z8 D0 `8 v, h' z- y3 r# |

五个智能体分工协作

7 g) M9 X- ^7 J( R

; k+ D! [, g$ U3 ?; i# }; }现在的自主AI科学家已经能够独立阅读文献、构思创意甚至执行代码实验。9 T9 D& Y% I8 _, P* o

但这些AI科学家对绘制学术插图仍然束手无策。8 Y5 u5 V U! G' G9 g$ K6 C0 y0 Q" s" C

学术插图的生成长期以来都是科研工作流中的瓶颈,它要求内容的准确性,还要求极高的审美标准。

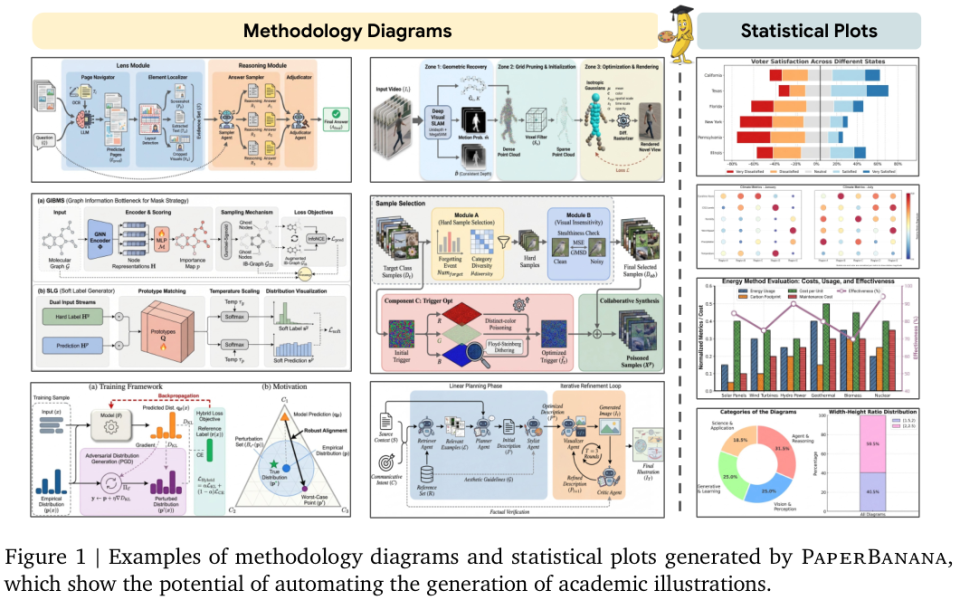

9 `) r, Q0 K7 P6 FPaperBanana框架模拟了人类的设计工作室,构建了一个由五个专业智能体组成的协作团队。

) n* g& W9 C" k" I E0 e

这个团队的第一位成员是检索器(Retriever Agent)。

这个团队的第一位成员是检索器(Retriever Agent)。

{) H6 U& n2 \4 L当用户输入一段关于方法的文本描述和图表标题时,检索器去翻阅参考图库。像一位经验丰富的图书管理员,在庞大的数据库中寻找与当前任务最相似的参考案例。: e( x9 y/ |' ]$ K" P: ^

利用视觉语言大模型(VLM)的推理能力,根据研究领域(比如是讲Agent的还是讲视觉的)以及图表类型(是流程图还是架构图)来筛选候选者。# Z3 v2 c! r' f0 L9 J5 `

检索器会看视觉结构的相似性,找出最相关的若干个例子作为后续工作的灵感来源。

, j* i6 B% _: ~+ A# B4 @4 U有了参考案例后,规划师(Planner Agent)随即登场。

! E$ q3 b, u5 e, X& f( l% k规划师是整个系统的认知核心,它接收源文本、意图以及检索器找来的参考图。% }8 u [, P/ _ p5 {: ^, l1 }

通过从参考案例中进行上下文学习,规划师将原本非结构化的长文本描述转化为一份详尽的、结构化的绘图计划。' I2 U. e' x! s8 u" [5 v

这一步非常关键,因为它解决了从抽象概念到具体视觉元素转化的逻辑断层问题。- X2 v p4 t0 x, \7 G, V

规划师不会直接画图,而是生成一份详细的文本描述,告诉后面的团队这张图里应该有哪些模块,模块之间的数据流向是怎样的,箭头该怎么指。! s2 [) P; ~+ q$ C1 Q; r4 r% O( E

紧接着是造型师(Stylist Agent)。. p( c4 r2 y* ], p$ n# @

很多时候AI生成的图片之所以看起来不像学术插图,是因为缺乏那种严谨、冷峻的学术风。5 i. t. q( U6 F) r; j

造型师的作用就是担任设计顾问。% M, e8 U6 p! u: A4 Z5 l( b

由于很难用一句话定义什么是学术风格,造型师会遍历整个参考图库,自动总结出一份美学指南。

/ W/ |! H) W2 T. [- Q; M这份指南涵盖了配色方案、形状容器、线条箭头样式、布局结构以及字体图标等关键维度。

x& |5 J! H# k3 m( j造型师拿着这份指南,对规划师生成的描述进行润色和修饰,确保最终生成的图在视觉上符合现代学术出版物的审美标准。

7 @! E9 g3 ], A0 H" v第四位成员是视觉化师(Visualizer Agent)。

+ F, V7 c8 O$ s1 T6 M6 d4 }) w* H2 V它拿着经过造型师优化过的描述,调用最先进的图像生成模型将文字转化为像素。# |& J4 V/ x l6 I, I

在这个阶段,文字描述变成了可视化的初稿。

% x7 a7 i2 ^; n+ g3 u% I对于方法论图表,它主要依赖图像生成模型;而对于需要精确数值的统计图表,它则会变身为程序员,编写Python代码来绘制图表。

* }. m% @+ W! ?3 s. D: S最后一位也是最关键的一位成员是批评家(Critic Agent)。

6 Y) w8 ?( z% v/ h0 m5 j$ v/ g在初稿生成后,批评家会介入。它拿着生成的图片和最原始的输入文本进行比对,检查是否存在事实性错误、视觉故障或者遗漏的信息。4 I( f% c- k* Y/ `; ]3 v" U! G

批评家会生成具体的反馈意见,并修改绘图描述。这个修改后的描述会再次交回给视觉化师进行重绘。

; j7 o2 j8 T1 }7 z6 i, |* J这个“生成-批评-修正”的循环通常会进行三轮,通过不断的自我反思和迭代,消除幻觉,修正细节,直到产出一张高质量的学术插图。

% }, r/ p" Z" h @" c) N+ K就像人类设计师不断修改草稿的过程,极大地提高了最终成品的质量。) m% p1 w, m' Y/ z3 d3 t3 s

严谨的绘图评估基准

( _2 P% O/ P. V6 {. d% y; M/ e( n5 [8 X c& f1 b# @* j

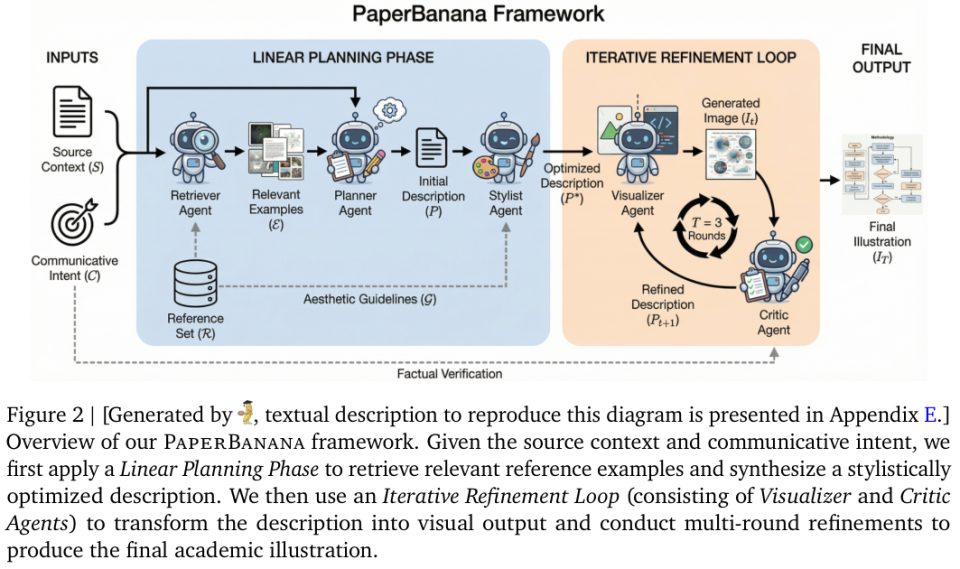

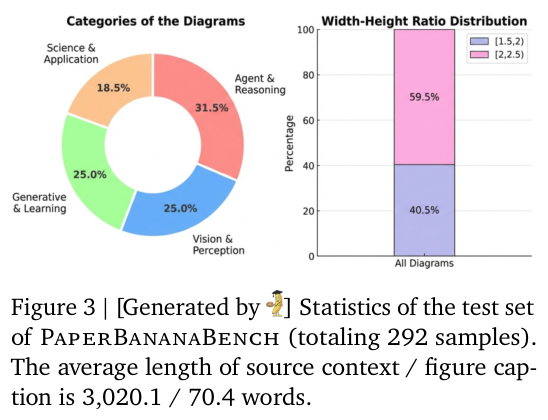

在学术插图生成这个新兴领域,缺乏高质量的评估基准。

- Y/ \' y" g7 ?$ y/ v研究团队构建了PaperBananaBench,这是一个专门针对方法论图表生成的综合基准测试集。

6 O3 _# s& o3 X- T, B这个数据集的来源非常硬核,全部取材于NeurIPS 2025的顶级会议论文。& T) c( ~3 T! D0 y3 x9 V: ?

研究人员通过工具从这些论文中提取了方法论部分的文本描述以及对应的图表和标题,确保了数据的真实性和高难度。

2 B& @. q, Q* ] I1 w数据的清洗过程相当讲究。

# X2 ^: G, @4 l8 U" O原始抓取的几千篇论文中,并非每一篇都适合作为测试用例。& j4 d. x: q( w+ J* U3 j

研究团队首先剔除了那些没有方法论图表的论文。; A8 Y2 } h' q4 K+ M, n

随后他们对图表的长宽比进行了严格的筛选,只保留长宽比在1.5到2.5之间的图片。4 z7 k0 U0 ^) }% s

这么做的原因很有趣,因为方法论图表通常需要较宽的横向布局来展示逻辑流,长宽比太小会显得拥挤;而长宽比过大又会超出当前图像生成模型的能力范围。( W+ C* q4 n( B5 ?0 o% R1 L/ k

如果将这些极端比例的图包含进来,在进行人机对比评估时,很容易通过图片形状就暴露出哪张是人类画的,从而引入评估偏差。

. j( a/ p) L. {

为了更精细地分析生成能力,研究团队还将收集到的图表分为了四个类别:智能体与推理、视觉与感知、生成与学习、以及科学与应用。

为了更精细地分析生成能力,研究团队还将收集到的图表分为了四个类别:智能体与推理、视觉与感知、生成与学习、以及科学与应用。

7 H9 b' }: C3 E( o6 K5 E这种分类有助于观察模型在面对不同领域知识时的表现差异。$ n2 q G+ D& d! r0 Q$ Y

最后经过人工的严格筛选和校验,留下了584个高质量样本,其中292个作为测试集,另外292个作为参考集,用于给检索器提供上下文学习的素材。

- I+ r. [$ S5 w+ b- e9 e" l& t C这个基准测试集的建立,为后续评估自动化绘图工具的性能提供了坚实的数据基础。! D& G6 F: N7 Z% K, g

评估图表的质量是一件非常主观的事情,传统的指标在这里完全失效。8 {0 n( j; T( ^: r, ?

研究团队采用了基于视觉语言大模型(VLM)作为裁判的评估方法。! }- r+ {# D+ L/ M8 [

考虑到人类评估既昂贵又不可扩展,他们验证了使用Gemini-3-Pro作为裁判的可靠性。

$ t! O X. [' F0 d: T评估分为四个维度:忠实度、简洁性、可读性和美观度。, S: B" Y' r3 R1 q

忠实度考察生成的图是否准确反映了文本内容;简洁性要求去除视觉杂乱,突出核心信息;可读性关注布局是否合理、文字是否清晰;美观度则衡量是否符合学术规范。/ N3 p1 B: o* R; f

在评分时,裁判模型会同时看到模型生成的图和人类绘制的原图,并根据文本描述判断哪一张更好。

. e g0 T% Z @ W这种基于参考的比较方法比单纯的打分更具鲁棒性。9 b. T: p( v6 a l# q

为了验证这种机器裁判的有效性,研究人员进行了严谨的一致性测试。

8 @6 r: \0 `0 I3 T5 u% z4 g' V0 W结果显示,Gemini-3-Pro的评判结果与人类专家的评判具有很高的相关性,这证明了用VLM来当裁判是可行的。

! d4 ]. l$ K/ o# n& F/ ] }这种自动化的评估流程使得大规模、标准化的图表质量测试成为可能,也为未来的研究指明了评估方向。3 p6 Y) n9 c% b: M% l

多项指标上超越现有基线" T3 ?+ \2 L, O2 Z5 I- h, q5 B

. @3 G/ ~: Y- m$ W9 `

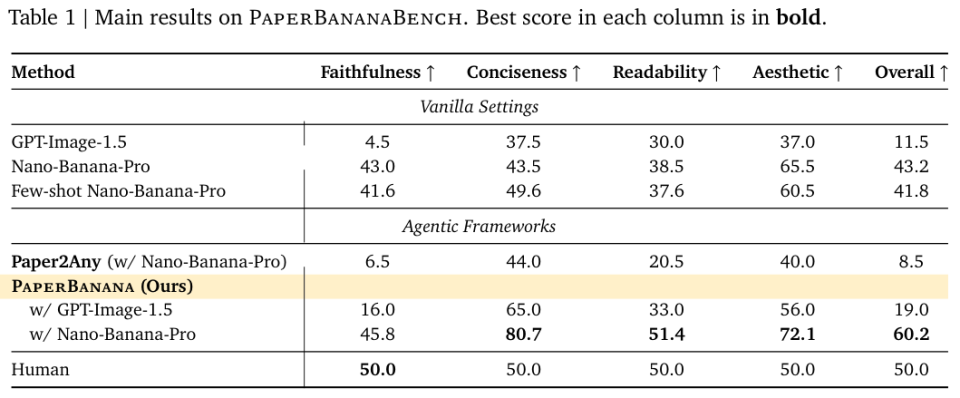

研究团队在PaperBananaBench上进行了广泛的实验,对比了PaperBanana与多种基线方法的表现。7 }: Q7 F9 s4 V2 D4 a

基线包括直接提示图像生成模型(Vanilla)、在提示中加入少样本示例(Few-shot)以及之前的相关工作Paper2Any。

* u& B/ T2 k. yPaperBanana在所有评估维度上都显著优于基线模型。

8 y! U0 F' ^0 \$ W: o

在忠实度上提升了2.8%,在简洁性上更是大幅提升了37.2%,可读性提升了12.9%,美观度提升了6.6%。综合总分提升了17.0%。6 @4 c# Q/ ^; ]. V: i5 ^

在忠实度上提升了2.8%,在简洁性上更是大幅提升了37.2%,可读性提升了12.9%,美观度提升了6.6%。综合总分提升了17.0%。6 @4 c# Q/ ^; ]. V: i5 ^

普通的图像生成模型如果不加引导,往往会生成视觉上过于繁复、充满幻觉的图像,或者文字渲染一塌糊涂。

+ U0 b+ e7 G6 ~7 Q' q2 I而PaperBanana通过造型师的风格约束和批评家的迭代修正,能够精准地控制生成内容的细节。! g; _0 M4 E4 k! L7 ~) d+ }

特别是简洁性的大幅提升,说明造型师和批评家非常善于砍掉那些不必要的装饰,让图表回归到“展示事实”这一核心原则上来。. B5 A# B) g, u- ~8 q" }6 T; J

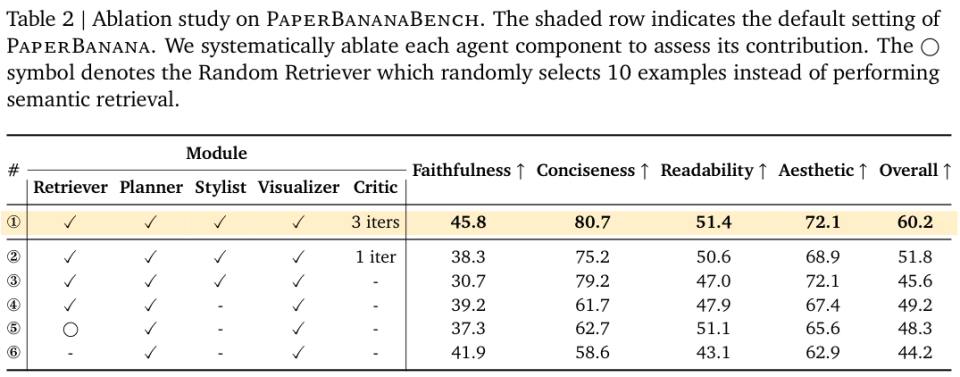

消融实验进一步揭示了每个智能体的贡献。

2 a L g3 P% o5 D4 A8 @, Y: j当移除检索器时,模型因为缺乏参考,生成的描述变得冗长且缺乏重点,导致简洁性和美观度大幅下降。

b: G$ B4 M& ?5 H# _" g当移除造型师和批评家时,虽然忠实度可能稍微保持,但简洁性和美观度都会受损。

* L4 m8 E9 D$ g4 Q3 v5 f# O0 A造型师的介入虽然极大地提升了美感,但有时会因为过度追求极简而丢失少量细节信息,这时候批评家的作用就显现出来了,它能够在后续的迭代中把丢失的关键信息补回来,在美观和忠实之间找到平衡点。

& F4 p5 A; N1 b) j$ N* h

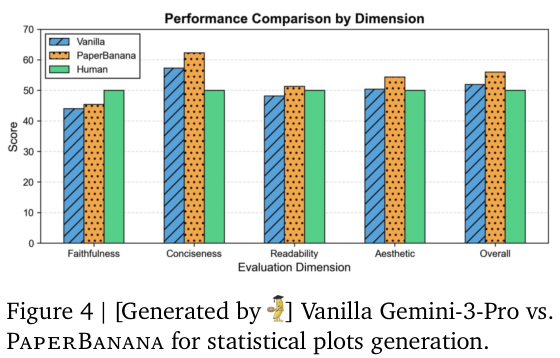

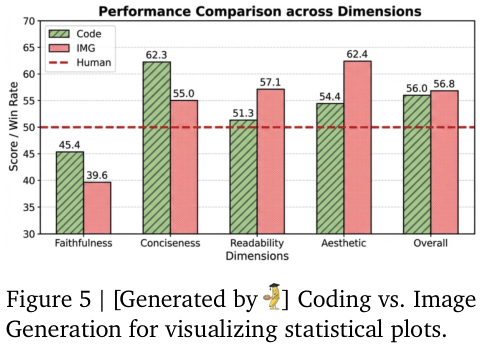

PaperBanana在生成统计图表方面也表现出色。( R0 K# n9 L6 I

PaperBanana在生成统计图表方面也表现出色。( R0 K# n9 L6 I

与方法论图表不同,统计图表对数值的精确性要求极高,哪怕一个数据点的偏差都是不可接受的。" m! n# N! n5 `+ o) ?$ I

与方法论图表不同,统计图表对数值的精确性要求极高,哪怕一个数据点的偏差都是不可接受的。" m! n# N! n5 `+ o) ?$ I

因此,在处理统计图表时,视觉化师不再依赖图像生成模型,而是转而生成可执行的Python Matplotlib代码。

9 U5 D# h1 D8 @# ~& }实验显示,这种策略在保持高美观度的同时,极大地保证了数据的忠实度。: Q8 n5 D R/ q# T# o% X7 _

相比之下,直接用图像模型生成统计图,虽然看起来很像那么回事,但在数据密集的情况下容易出现数值幻觉或元素重复的问题。6 k0 }; M) ~/ K% T# v8 Z

PaperBanana这种根据任务类型灵活切换“绘图”与“写代码”模式的能力,展现了其强大的适应性。1 W1 H% a6 `/ |1 Q1 t

PaperBanana这种根据任务类型灵活切换“绘图”与“写代码”模式的能力,展现了其强大的适应性。1 W1 H% a6 `/ |1 Q1 t

更有意思的是,PaperBanana不仅能从零生成图表,还能帮人类改图。* _7 b. A E& m# C' C; C: j

研究人员尝试让PaperBanana根据其总结的美学指南,对人类绘制的现有图表提出修改建议并重新绘制。' J8 G6 Y$ G4 H( A" T) ]

结果发现,经过PaperBanana润色后的图表在美观度上往往能战胜人类的原作。! d! M5 t. n# [8 w) ^+ I O$ V n& I

表明该框架中蕴含的设计知识已经达到甚至超过了一般科研人员的平均设计水平,它不仅是一个生成工具,更是一个潜在的图表美化助手。1 T2 M; I$ d2 B; `

当然,PaperBanana目前生成的结果本质上是光栅图像(像素图),而不是科研界更偏爱的矢量图。, j: W6 s x- @" B$ D! ^- g

如果你放大看,可能会看到像素锯齿,而且后期编辑起来非常困难,不像矢量图那样可以随意拖动节点。, e$ Q) `; O h1 L! ~$ N

在处理极其细微的连接关系时,比如箭头到底是连在这个框的左边还是下边,它偶尔还是会犯迷糊,这些细微的结构性错误有时候连批评家也没能揪出来。

: ~! m$ f% U+ ^未来的研究方向可能会集中在生成可编辑的矢量图形,以及进一步提升模型对细粒度视觉结构的感知能力上。2 P4 J4 X: W+ {- z; @- e

参考资料:9 x6 q% O" Q1 i

https://dwzhu-pku.github.io/PaperBanana/8 O+ c+ t$ \, h$ B. Z) ?7 e( F2 c

https://arxiv.org/pdf/2601.23265- R/ }! D; K+ N( `; h, J+ S' g/ A

https://github.com/dwzhu-pku/PaperBanana |

|