|

|

金磊 发自 凹非寺

$ k8 q- U% B: S量子位 | 公众号 QbitAI

& u: M& C6 z9 X# j) d , h1 Y8 ^5 ]/ f

不得了,机器人现在开始学会脑补未来了。

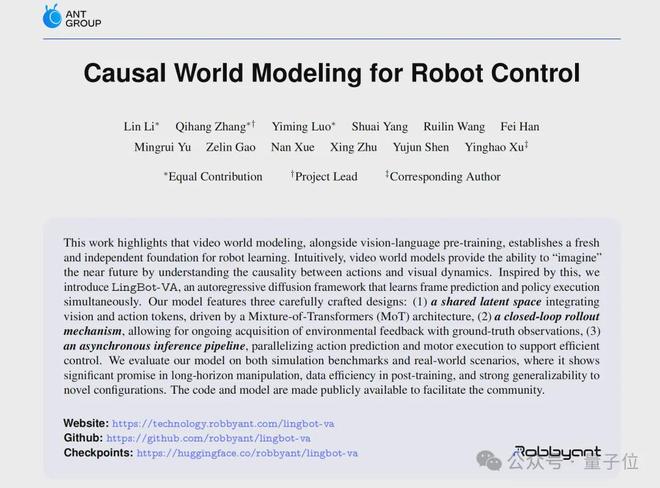

( v7 @" C$ x3 b2 t这就是蚂蚁灵波又又又又(连续第4天)开源的狠活儿——

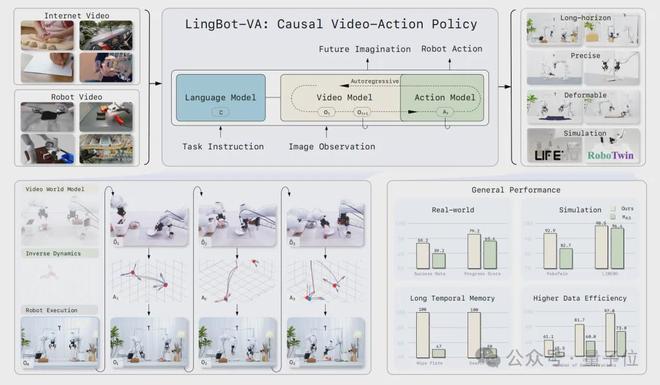

( U) p; i* I2 {* y, n8 v+ I全球首个用于通用机器人控制的因果视频-动作世界模型,LingBot-VA M% ?' s- F1 h |9 \( v1 `. k

' i2 c6 E2 A/ L$ n) ^4 F5 n& v" B' m* r( K- j

& l" j- h) [9 n+ Y# F4 E5 R# |

怎么个脑补法?0 K' W! V8 j# A: v. i7 @! h( }

简单来说啊,以前的机器人(尤其是基于VLA的)干活儿,主打一个条件反射:眼睛看到什么,手立刻就动一下。

- Y. H# `4 h% a8 r: O% x Q. x0 {这叫“观察-反应”模式。( Y6 o( v1 Q* q5 T6 h8 u. |

但LingBot-VA就不一样了,它通过自回归视频预测打破了这种思考方式,在动手之前,脑子里先把未来几秒的画面推演出来。( W. w* Q4 n" l; u' x3 V1 Q' k

说实话,用想象力做决策,在机器人控制这块还是相当新鲜的。

. V Q9 ]$ A) k+ K) P7 v: l5 [$ G但这不是LingBot-VA唯一的亮点,还包括:

! X/ u7 S1 v0 D5 S" l: Z$ b- U+ {0 A) J+ e, U& W: M

8 L* Z& z# `6 p- 记忆不丢失:做长序列任务(比如做早餐)时,它会记得自己刚才干了什么,状态感知极强。

9 V6 h2 p6 e9 d% O - 高效泛化:只要给几十个演示样本,它就能适应新任务;换个机器人本体,也能hold住。

I9 _" I ~) h f, s

! R" B! V/ t7 r& a% q

+ b3 R6 t' \) ?/ Q+ T5 b7 k9 ^" a0 s& k, V3 F1 {5 u& Q1 D- f

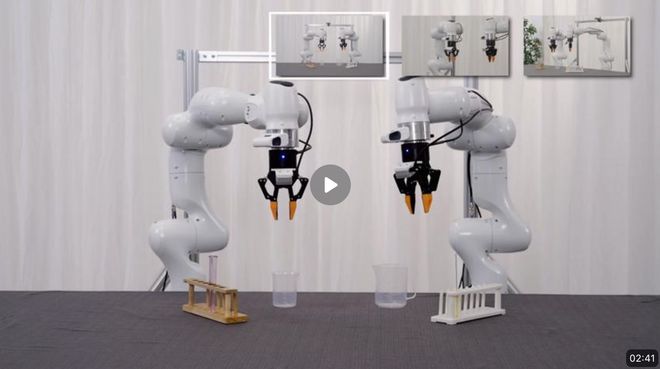

) z& v! H1 ]: C U因此在LingBot-VA的加持下,像清洗细小的透明试管这种高精度任务,机器人已经是可以轻松拿捏:

: j0 C0 O! N5 ]( x& I

8 _6 v& m" c! Y1 _

8 _6 v& m" c! Y1 _

1 u' T/ d! a# A( {6 S' V; F6 t: v, b4 _6 J4 K# _. L

视频地址:https://mp.wEIxin.qq.com/s/xqE6C72usddKMc4EH89myA

8 a+ W7 I8 X ?' q正如我们刚才提到的,今天是蚂蚁灵波连续第四天开源。5 C, f Q5 D+ F3 X1 U' M

如果说前几天的开源是给机器人加强了眼睛(LingBot-Depth)、大脑(LingBot-VLA)和世界模拟器(LingBot-World),那么今天的LingBot-VA,就是让这具躯壳真正拥有了灵魂& o& h4 K0 s9 h7 I. i

一个行动中的世界模型,让想象真正落到执行层面。

* U( f9 e! h7 w如此一来,通用机器人的天花板,算是被蚂蚁灵波往上顶了一截。1 O* X6 ~1 D" s2 C

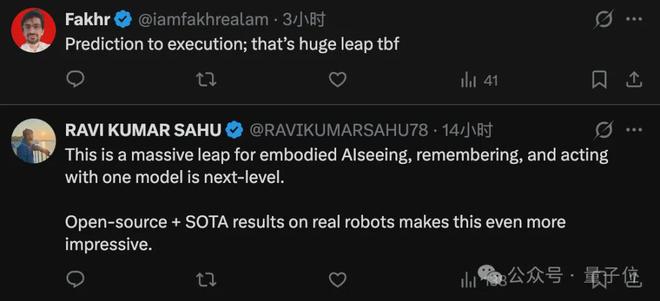

正如网友所述:

% z6 Q" }" r* Q0 u) K! T( s W/ p) g* ~. ?

6 i1 J: ]1 s; p( r6 U7 \7 {

2 a$ n1 W5 X, J) x0 w5 I- 从预测到执行;说实话这是巨大的飞跃。1 w/ d, m+ z& ~: y5 l

% d" H, J) z1 y$ R! i. L( Q n& R

" g! \8 M" y% B; n* u# D

" g! \8 M" y% B; n* u# D

7 ^; L9 }6 h K

. X6 n" k0 G2 t3 m$ R1 s1 e- N$ Q

让想象力先行一步4 v2 E n4 V; n; B. E

1 p9 Q. S' X$ O# X# [5 D' r' q% y* @$ N8 n6 W2 w; [6 u: ^. f

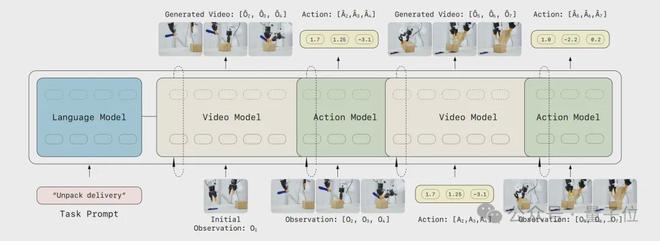

LingBot-VA在架构设计上选择了一条更进一步的路径。7 m8 Y! e) E6 b0 R, ?5 y

在传统的VLA(视觉-语言-动作)范式中,模型通常会将视觉理解、物理变化推理、低层动作控制这三项复杂任务放在同一个神经网络中处理,这在学术界被称为表征缠绕(Representation Entanglement)。

* o! |) |# V0 _, H为了追求更高的样本效率和更强的泛化能力,LingBot-VA选择把这团乱麻解开,提出了一套全新的解题思路:先想象世界,再反推动作。* D! a7 H9 H6 o1 I

为了实现这个想法,蚂蚁灵波团队采用了一个两步走的策略:

' w. q9 | I; I& d. ~& g+ A5 O

9 h2 z& g+ p. @, e: o

; u0 `0 n3 b6 {3 n9 P) Z- 视频世界模型:先预测未来的视觉状态(接下来会发生什么)。- H6 g& S2 L6 d- H, w

- 逆向动力学(Inverse Dynamics):基于视觉的变化,反推出应该执行什么动作(为了达到这个画面,手该怎么动)。% v: [+ L0 `- d2 s. T& B" K

" z9 M' j0 L, S( B1 j: Y3 O这与传统VLA有着本质区别:它不直接从“现在”跳到“动作”,而是要经过一下“未来”这个步骤。

& Y e8 k5 ~; H' O如何实现?蚂蚁灵波团队主要将三个架构层面作为突破口。

8 P- L- v5 T; n& N. x1 |# p; x

% ~$ o( g' H7 o* O- t6 c* ]9 u6 D ~, X6 ^1 F( m9 N: `. V

2 I9 K3 u( a4 n+ z首先就是视频与动作的自回归交错序列) U! m: ~1 Y9 x; W$ G9 b

在LingBot-VA的模型里,视频Token和动作Token被放进了同一条时间序列里。

) g7 x5 k, g" D/ N: K- [0 r7 C8 y为了保证逻辑严密,团队引入了因果注意力(Causal Attention)。这就像给模型定了一条死规矩:只能用过去的信息,绝对不能偷看未来。0 V" d/ p) }* h' p8 n) E% H+ f

同时,借助KV-cache技术,模型拥有了超强的长期记忆。它清楚地知道自己三步之前做了什么,任务绝对不会失忆。* W2 w: s) \6 W# W: U8 B& Q! `

I1 }( [- _6 I8 g2 e

% x! N& e$ r3 G3 @3 B: r- X3 O' m( p3 |: N+ K; |

其次是Mixture-of-Transformers (MoT) 的分工协作

6 n% M+ N( d5 C, W, e0 k$ v$ }这一步主要是为了解决我们前面提到的表征缠绕的问题。) _# M+ w5 C# s' I+ w: P

我们可以把过程理解为“左右互搏”,但又很默契的一种配合:

$ v, Q6 h. c+ h' z' m, F# Z$ X3 ]4 ?, O( b6 U3 m

6 G0 P1 V; m+ C4 Q2 U* Y; p7 h

- 视频流:宽而深,负责繁重的视觉推演。

7 C4 z% r- W. h. j; J0 h - 动作流:轻而快,负责精准的运动控制。

1 V( l3 w. ^' T7 f5 O

3 h1 w$ N/ j, {2 t! g" j) C这两个流共享注意力机制,信息互通,但在各自的表征空间里保持独立。

. V8 S6 {1 V) R! Z0 z! o这样一来,视觉的复杂性不会干扰动作的精准度,动作的简单性也不会拉低视觉的丰富度。1 b; u' h7 R% G: ^& @/ @

最后就是工程设计相关的工作。5 h* N6 x& J" d' }; a3 J

毕竟光有理论是不好使的,“实践才是检验真理的唯一标准”:; E1 @9 F' a- O8 @

. @$ }1 F$ \4 C3 b, P' s3 v, ]- u* D& [4 o8 J9 n/ D2 V; F

- 部分去噪(Partial Denoising):做动作预测时,其实不需要每一次都把未来画面渲染得高清无码。模型学会了从带有噪点的中间状态里提取关键信息,计算效率大大提升。

+ G$ I7 j+ `0 y- K' U) U - 异步推理(Asynchronous Inference):机器人在执行当前动作的时候,模型已经在后台疯狂计算下一步了。推理和执行并行,延迟感几乎消失。3 }+ k5 D% I2 B7 \% @4 a: Q

- FDM 接地(Grounding):为了防止模型想象力脱离现实,系统会用真实的观测数据不断校正想象,避免出现开放式的幻觉漂移。

1 a$ ]: M7 Y: z" |" r 实验结果与能力验证2 I/ |- T1 F i: ?

! h( j2 C: m- i8 p) z2 a

4 e0 Z2 r& B Y" u# ^$ p

在了解完理论之后,我们再来看实验效果。5 ]- i! G* Z6 E0 O" c$ S

蚂蚁灵波团队在真机实验和仿真基准上,对LingBot-VA进行了全方位的实测。

( V( Q9 ~( z: [6 W+ U在真机测试中,LingBot-VA覆盖了三类最具挑战性的任务。 ^5 p7 }! w0 f" N4 u! f: I p

首先是长时序任务,比如准备早餐(烤面包、倒水、摆盘)、拆快递(拿刀、划箱、开盖)。/ p0 b8 o9 }7 E7 ?7 O, B% V

2 I; I0 x) ]9 v! }( X- @) D- d# j3 F" O- L `) R$ O

_& ~- t s2 N2 u! m/ V2 Y. V视频地址:https://mp.weixin.qq.com/s/xqE6C72usddKMc4EH89myA

3 z- }- E% {3 S) [! L& ^) z这些任务步骤繁多,但凡中间有一步有误,那可以说是满盘皆输。从LingBot-VA的表现来看,一个字,

2 V$ G5 u) z8 Y% n即便是不小心失败了,机器人也会记得进度,尝试重来。

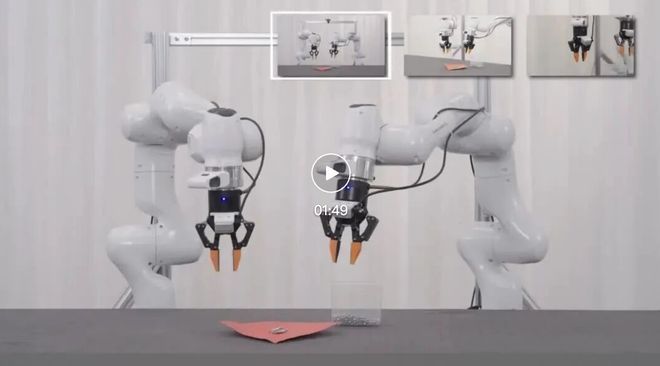

4 t' C* t2 m4 ^, W0 {& r: I第二类是高精度任务,比如擦试管、拧螺丝。

2 ]" h' B0 P1 |1 l/ B# }

1 w8 a/ k1 @! c1 T) G' B

1 w8 a/ k1 @! c1 T) G' B

& A' U9 e* s: g8 Y: s1 v: z

) V; ^+ C2 H3 C6 z+ a视频地址:https://mp.weixin.qq.com/s/xqE6C72usddKMc4EH89myA& r) A5 s2 P4 w

这要求动作精度达到毫米级,得益于MoT架构,动作流不再受视觉噪声的干扰,手极稳。% ^6 J2 U( s) g7 c% {6 r

刚才我们已经看了擦拭管的案例,再来看个拧螺丝的:) _" \2 r3 l% B, f- I t

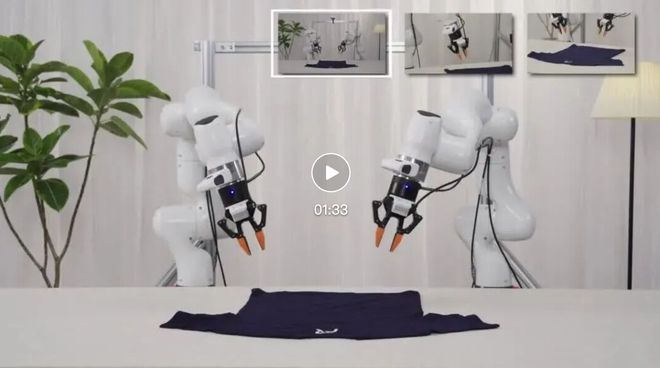

第三类任务是针对可变形物体,例如折衣服、折裤子。

& i2 [. P" K% C0 L. K" d) ]. |" K& u

% @# \4 Y5 ` C2 j M+ I* v

" W l8 L) r9 o; s9 Y& Q$ U e2 v9 d

视频地址:https://mp.weixin.qq.com/s/xqE6C72usddKMc4EH89myA

# V/ i- d9 F5 f5 J c) r这些任务的难点在于物体处于一个随时变化的状态,但LingBot-VA通过视频推演,预判了布料的形变,操作行云流水。

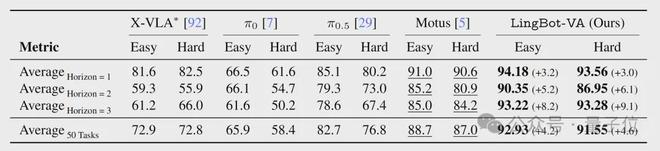

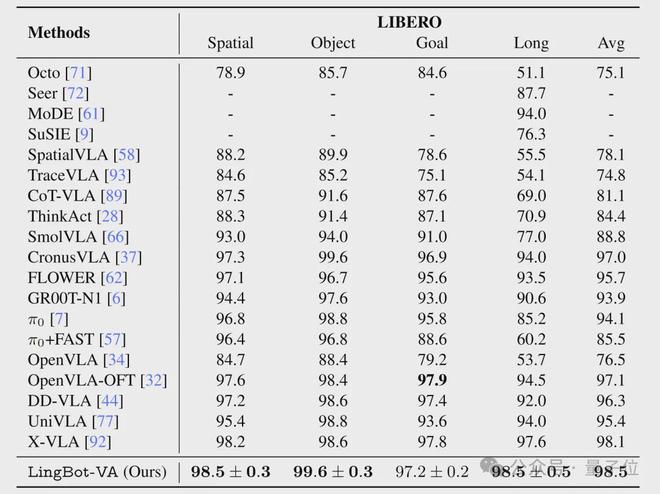

a6 n' q B7 M0 s/ T7 a6 o) i( {; `1 q除此之外,LingBot-VA在RoboTwin 2.0和LIBERO这两个硬核仿真基准上,也是很能打的。! g3 _( m5 Q, a8 c* |$ H

尤其是在RoboTwin 2.0的双臂协作任务中,无论是简单的固定场景(Easy),还是复杂的随机场景(Hard),LingBot-VA都展现出了不错的实力:

5 M$ X2 p: a J) X

/ q; z" J# l6 R9 W: `0 ` W9 u, N: E4 W9 [, r3 [$ M

- RoboTwin 2.0 (Easy):成功率92.93%,比第二名高出4.2%。( I& N- q- y C& |4 m; K

- RoboTwin 2.0 (Hard):成功率91.55%,比第二名高出4.6%。# F9 O; J5 X3 k) |! e

8 T! U/ s# [7 t% y- P# {

+ h# l! X) W" L/ ]# M

+ h# l! X) W" L/ ]# M

5 A% E4 A8 A! T$ u5 G+ F

& E$ H% T S4 g% ^7 U而且有一个趋势非常明显:2 Q+ ]; f; l! a6 `2 x, |1 ^

任务越难、序列越长(Horizon变大),LingBot-VA的领先优势就越大。8 d; N. i& Z4 a6 n$ x8 J, m

在 Horizon=3 的长任务中,它的优势甚至扩大到了9%以上。

+ g- F: M: z2 j) }, N1 P而在LIBERO基准测试中,LingBot-VA更是拿下了98.5%的平均成功率,刷新了SOTA记录。: S- p( u9 h' B6 _

: l- X. D; B( W! w$ P5 o9 N

: l- X. D; B( W! w$ P5 o9 N

; h) i+ f; \% g3 M% H8 ^, t" u

, l# Z0 P! u- H9 j+ Z总结一下,通过这些实验,我们可以清晰地看到LingBot-VA的三个核心特质:- t0 D: H; d7 x6 O1 I; F: P

1 s8 O8 E4 J5 ^! u8 ?' S+ I( a2 w$ H; ]# C8 f. T4 E

- 长期记忆:在一个来回擦盘子的计数任务中,普通VLA模型擦着擦着就忘了擦了几下,开始乱擦;LingBot-VA 则精准计数,擦完即停。这就是KV-cache的起到的作用。7 R; G% k8 S: p- E7 o2 r! G# ~; X

- 少样本适应:面对全新的任务,只需提供50条左右的演示数据,稍微微调一下,它就能学会。这比那些动辄需要成千上万条数据的模型,效率高了几个数量级。

+ b6 j+ S# Y: |; p" b - 泛化能力:训练时用的是某种杯子,测试时换个形状、换个颜色,或者把杯子随便摆个位置,它依然能准确识别并操作。

) K- t3 `. `! m* l; b! u3 M

" h/ d' @8 J+ \ s

. P" x3 _$ C9 \+ d. G

. P" x3 _$ C9 \+ d. G

; A4 r3 y" o$ c. O" U9 Y

! d* F* ~: ?# J4 M) v: g: b+ X# Q* K3 z- |

连续四天开源,已经产生影响

7 F/ Y+ n7 w3 i0 u1 q

: t1 E$ I2 _ [" N8 j$ w- b* q' I0 e2 f( U) r2 \

把时间轴拉长,回看这四天的连续开源,我们会发现蚂蚁灵波下了一盘大棋。1 v7 e1 \' u- x- x: f7 R

因为这四个开源项目拼凑在一起,就会形成一条非常清晰的技术主线:! j6 s6 f" I/ d, o! d( W6 {

t8 U0 m) n& B/ C1 j0 i$ k. y+ O5 D

% |3 ?- O. q/ u" w: J( X- Day 1: LingBot-Depth——解决“看清”的问题。让感知能够更加清晰。# ?' ]& |+ w- N( Z7 C

- Day 2: LingBot-VLA——解决“连接”的问题。打通语言、视觉到动作的通用接口。" Z0 H8 ? {6 W) U. o1 W; k

- Day 3: LingBot-World——解决“理解”的问题。构建可预测、可想象的世界模型。0 {0 Y# I& B! P% a

- Day 4: LingBot-VA——解决“行动”的问题。把世界模型真正嵌入控制闭环,让想象指导行动。

3 m: Y0 z+ i1 |+ P% }6 o* h

' L5 T8 M9 a+ a4 \( V. z: d这四块拼图凑在一起,释放了一个强烈的信号:

' Y5 l5 K9 ?' a6 M通用机器人正在全面走向视频时代。3 x4 q5 Q/ {8 _$ q

视频,不再仅仅是训练用的数据素材,它正在成为推理的媒介,成为连接感知、记忆、物理和行动的统一表征。

' \- y) O1 {/ g* D这对于整个行业来说,价值是巨大的。

7 Y2 j, [, M0 R- t$ [! o( L对通用机器人来说,长任务、复杂场景、非结构化环境,这些曾经的硬伤,现在有了系统性的解法。

8 w. S2 x0 j# N# y从具身智能路线来看,世界模型不再是一个可选项,它正式成为了机器人的中枢能力,从“能动”进化到“会想再动”。

$ ~! g5 c2 J, |并且蚂蚁灵波的持续不断地开源动作,不仅仅是提供了代码、模型这么简单,更是一条可复现、可扩展的技术范式。- B7 R- n4 y5 T/ F

而蝴蝶效应也在行业中开始显现。

! H* z3 ?# j( U% r7 j3 x E; g. m就在这两天,谷歌宣布通过Project Genie项目让更多人体验Genie 3;宇树科技宣布开源UnifoLM-VLA-0……& K% F' k% w- P; t6 o

海外媒体也对蚂蚁灵波的开源动作有了不小关注,点评道: l" H u- h' A5 T/ p

, d/ r, M" Z. Q; I- H. x: y& X+ h1 h; s

9 C8 [; H, c8 W* n- 蚂蚁集团发布了名为LingBot-World的高质量机器人AI模拟环境。这家中国金融科技公司完善了一套完整的开源工具包,用于物理AI系统的开发。这也是在全球机器人领域主导权争夺战中的一项战略性举措。

' Q+ f3 e4 r6 Y# D# P) r/ Y8 ~" B

2 r8 }4 S8 j5 W( O5 _ n

. R% F4 R" H, y

. R% F4 R" H, y

. b6 g2 A6 q1 }3 X k9 l9 ]

" v0 R3 b4 J- B, Z$ i! N嗯,蚂蚁灵波的压力是给到位了。- `2 z9 a s$ W3 m+ b' ?2 J8 O

总而言之,LingBot-VA的出现,标志着世界模型第一次真正站上了机器人控制的主舞台。/ ] [4 S* r6 }+ W

项目地址:8 X. {. e. g1 `

https://technology.robbyant.com/lingbot-va

/ b [8 U; u* L. k& n$ I, zGitHub地址:2 u- t k+ I5 s- m/ e% `" M' ], H

https://github.com/robbyant/lingbot-va4 Q. e6 `/ J# J8 j, ^4 Z6 |7 b

项目权重:1 m$ U" ^2 o0 Y* S

https://huggingface.co/robbyant/lingbot-va

. e+ q5 v1 p5 X0 a$ Y( g# O9 i8 Uhttps://www.modelscope.cn/collections/Robbyant/LingBot-va |

|